Meta Ingin Mendorong AI Ke Level Berikutnya Dengan ImageBind Open Sourcenya

Meta mengklaim model AI open-source barunya, ImageBind, adalah langkah menuju sistem yang meniru cara manusia belajar dengan lebih baik, menggambar koneksi antara beberapa jenis data sekaligus mirip dengan cara manusia mengandalkan banyak indera. Ketertarikan arus utama pada AI generatif telah meledak dalam beberapa tahun terakhir dengan munculnya generator teks-ke-gambar seperti DALL-E OpenAI dan model percakapan seperti ChatGPT. Sistem ini dilatih menggunakan kumpulan data masif dari jenis materi tertentu, seperti gambar atau teks, sehingga pada akhirnya mereka dapat belajar membuat sendiri.

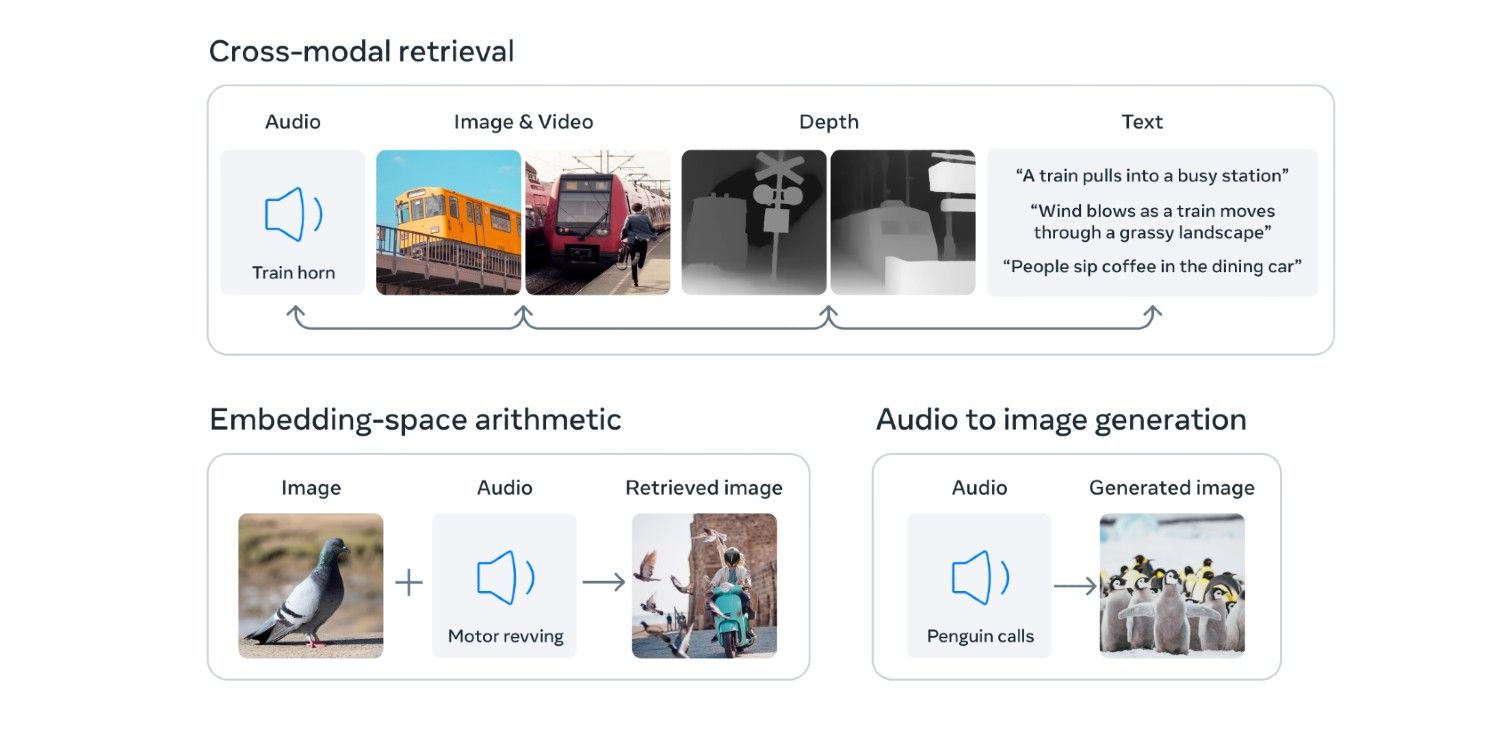

Dengan ImageBind, Meta bertujuan untuk memfasilitasi pengembangan model AI yang dapat menangkap gambaran yang lebih besar. Mengambil lebih “menyeluruh” pendekatan pembelajaran mesin, ini dapat menghubungkan enam jenis data yang berbeda: teks, visual (gambar/video), audio, kedalaman, suhu, dan gerakan. Kemampuan untuk menarik koneksi antara lebih banyak jenis data memungkinkan model AI untuk melakukan tugas yang lebih kompleks — dan menghasilkan hasil yang lebih kompleks. ImageBind dapat digunakan untuk menghasilkan visual berdasarkan klip audio dan sebaliknya, menurut Meta, atau menambahkan elemen lingkungan untuk pengalaman yang lebih imersif.

Menurut Meta, “ImageBind melengkapi mesin dengan pemahaman holistik yang menghubungkan objek dalam foto dengan bunyinya, bentuk 3Dnya, seberapa hangat atau dinginnya, dan bagaimana gerakannya.Model AI saat ini memiliki cakupan yang lebih terbatas. Mereka dapat belajar, misalnya, menemukan pola dalam kumpulan data gambar untuk kemudian menghasilkan gambar asli dari petunjuk teks, tetapi apa yang dibayangkan Meta lebih jauh lagi.

Gambar statis dapat diubah menjadi adegan animasi menggunakan petunjuk audio, kata Meta, atau modelnya dapat digunakan sebagai “cara yang kaya untuk mengeksplorasi kenangan” dengan mengizinkan seseorang untuk mencari pesan dan perpustakaan media mereka untuk acara atau percakapan tertentu menggunakan perintah teks, audio, dan gambar. Ini bisa membawa sesuatu seperti realitas campuran ke tingkat yang baru. Versi mendatang dapat menghadirkan lebih banyak jenis data untuk mendorong kemampuannya lebih jauh, seperti “sentuhan, ucapan, penciuman, dan sinyal fMRI otak” ke “memungkinkan model AI yang berpusat pada manusia yang lebih kaya.”

ImageBind masih dalam masa pertumbuhan, dan Meta peneliti mengundang orang lain untuk menjelajahi model AI sumber terbuka dan mengembangkannya. Tim telah menerbitkan makalah di samping posting blog yang merinci penelitian, dan kodenya tersedia di GitHub.